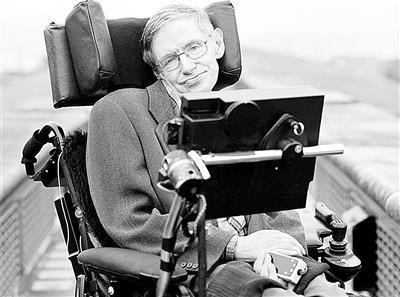

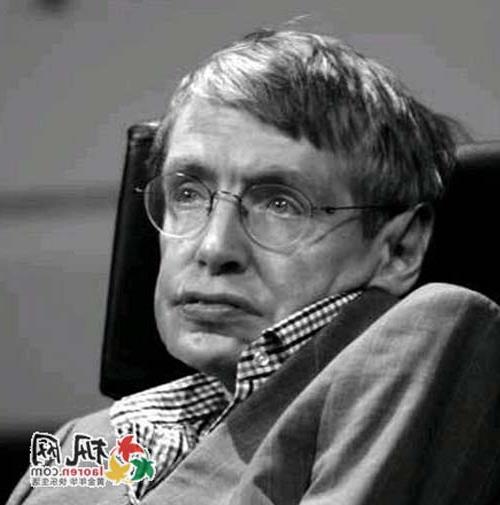

史蒂芬霍金警示:人工智能是“真正的危险”

“钢铁侠”、“火星人”,缔造了特斯拉汽车和SpaceX火箭的埃隆马斯克是如假包换的“科学狂人”,可喜的是马斯克有足够的理性来驾驭自己的狂放。

上周未,马斯克在Twitter上表示,“我们要非常小心人工智能,它可能比核武器更危险。”就在今年早些时候,马斯克接受访谈提到詹姆斯卡梅隆30年前的经典之作《终结者》。他说“那绝对是人类会极尽所能去避免的情形。 既然已有这样的警示电影,我们必须要小心。“

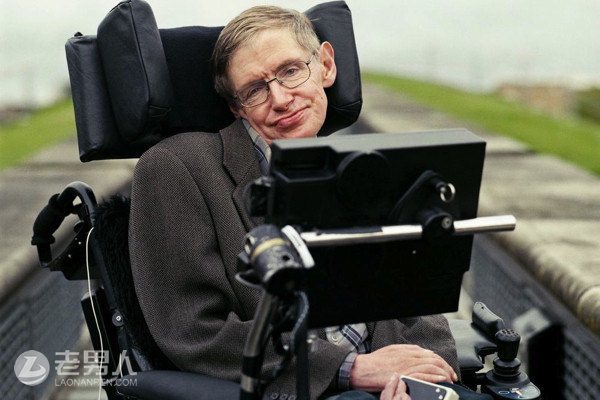

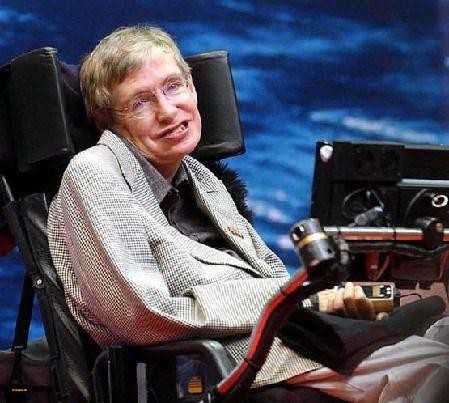

史蒂芬霍金也是人工智能的示警者,在接受HBO访谈时,他说“人工智能可能是一个‘真正的危险’。机器人可能会找到改进自己的办法,而这些改进并不总是会造福人类。”

对人工智能持乐观态度者的典型信念是”人类不可能被人工智能超越,因为我们可以利用人工智能来加强自己。不会出现我们和机器对抗的局面。通过与智能产物融合,人类可以加强自己的能力。”这种想法过于想当然了。假如发明枪支的人们说“枪支是对付豺狼、猛兽的,可以让人类变得更强。不会出现用枪支伤害同类的局面……”回过头来看这些信誓旦旦不可笑吗?

有史以来,几乎所有尖端技术都最先被用于战争,人工智能亦会被优先用于杀戮。与普通的枪炮乃至核武器相比,这个系统会不断学习提高杀人效率,会自我修复、升级,会千方百计维持能源供给……制造者有把握控制它们吗?谷哥的工程师就能吗?抑或制造者本身就是反人类恶魔怎么办?

其实,生命体与非生命体的本质区别在有无求生本能。所谓求生本能就是对自己生命的爱,从这种爱可以衍生出贪婪、恐惧等情感。从小小孩童的好奇心到太空探索,根本的驱动力都是求生本能。太空飞船再复杂,没有求生本能就不是生命体,而是机器。单细胞生物再简单,有了求生本能就是生命体。 抗菌素是细菌产生的毒素,以杀死其它细菌,独霸生存环境及营养物质。

对人工智能来说:不给求生本能,它就不可能完全象人一样思考,终究是机器。给求生本能,让它们懂得爱自己的“生命”,人类对它们有何价值?机器需要人类为它做饭、打扫房间吗?试图关掉电源,终结机器“生命”的人会不会被能够“察言观色”甚至有了“直觉”的机器先发制人地终结?

好在人工智能不可能一步到位,当“终结者一代”出现时,来不及造成多大恶果就会被人类轻易终结。但愿那时候微软、谷哥的工程师们可以正视霍金、马斯克们的警示。